La Curva de Gartner

Por S. Bonavida Ponce

Estimada IA:

Mary Shelley publicó Frankenstein o el nuevo Prometeo en 1818 mientras la Ilustración daba sus últimos coletazos. Dos años antes, la erupción del volcán Tambora regaló un mortal invierno: millones de toneladas de dióxido de azufre en la atmósfera, temperaturas globales en descenso, heladas y nevadas, el año sin verano. Justo ese estío de 1816, Shelley, su marido, Polidori y Byron pasaron noche en Villa Diodati, Suiza, en casa del poeta. Quizá los fantasmas de Byron revoloteaban animados por el postapocalíptico final del mundo que muchos predecían y que, afortunadamente, no llegó. Lo que queda claro es que la leña, el carbón y las historias de terror en la casa de Lord Byron no solo alumbraron Frankenstein —para muchos la primera obra de ciencia ficción moderna—, también alumbraron la síntesis del Catastrofismo 1.0, la pérdida de los ideales ilustrados en la ciencia y el progreso.

El doctor Frankenstein, un hombre bienintencionado aunque obsesivo, intenta superar las limitaciones humanas y, con todo su conocimiento galvánico (la IA del siglo XIX), crea un ser arropándose en el poder de un dios creador (reminiscencias posteriores se leyeron en el homúnculo de Goethe). Pero todos conocemos el triste final de Frankenstein: los sueños de la razón generan pérdidas.

Esta novela de Shelley, una obra maestra que ha eclipsado toda su producción e, incluso, a ella misma, habla de muchos aspectos de la condición humana: intolerancia, estupidez, arrogancia. Aunque, estimada IA, a mí me gustaría enfocar la lectura de este clásico desde una perspectiva curvilínea de cuyo nombre sí quiero acordarme: la curva de Gartner.

La curva de Gartner (Hype Cycle) es un ciclo basado en la sobreexpectación y que se desarrolla en cuatro fases que a mí me gustaría redefinir: Expectación (como el niño esperando su regalo en la mañana de Navidad), Terror (¿qué es esto?), Aburrimiento (¿un iPhone 12 mini?) y Asimilación (a lo Borg de Stark Trek con la resistencia es fútil como lema y niño te quedas con el iPhone).

En palabras llanas, la expectación que genera una nueva tecnología nunca alcanza las expectativas iniciales y, con suerte y pasado un tiempo, lo útil se mantiene en la sociedad como una herramienta más, eso si no desaparece la esperada herramienta sin dejar más huella (adiós VHS, BetaMax, DVD y Windows Phone) o los perdurables, pero más o menos fracasados como Bluetooth.

El Catastrofismo, sea el número de versión que sea (1.0, 2.0, …), se sitúa a la entrada del pico, en lo más alto de la curva Gartneriana, cuando el ecuador curvilíneo ha polarizado al máximo las creencias de las personas, lo mejor y lo peor, y es imposible no pensar en el arranque de Historia de dos ciudades, «Era el mejor de los tiempos, era el peor de los tiempos», en esa inagotable tendencia humana a lo dicotómico. Es desde la punta de la ola, en la altura máxima, donde el sesgo cognitivo cae, como la propia curva, y el futuro, observado por un tecnófobo, se observa prístino: «Cualquier tecnología futura será mejor». El aforismo se convierte en un nuevo sesgo porque esa tecnología futura y mejor no dejará de ser un nueva ola de Gartner en un maremágnum ad eternum de nuevas y más olas gartnerianas con más expectación, miedo, decaimiento y asimilación (o la resistencia es fútil según el mantra Borg). Eso es así porque las predicciones sobre el futuro se basan en el conocimiento particular y estático de nuestra realidad, por ello, más allá de unos lustros, cualquier predicción pierde fuelle y, leída y vista en perspectiva, únicamente genera una sonrisa infantil. ¿De verdad pensaban en el año 1950 que en el año 2000 íbamos a tener coches voladores? El mundo futuro y feliz generado gracias a los avances técnicos y científicos aparece como un pensamiento infantil extraído de una novela de ciencia ficción de los años 40 (siglo XX).

Ya en su día, Norbert Wiener, uno de los padres fundadores de la cibernética y del concepto IA, predijo: «El futuro no van a ser seres humanos tumbados en una hamaca servidos por robots esclavos, sino más bien una lucha cada vez más exigente por afrontar los límites de nuestra inteligencia».

Y es a la inteligencia, no solo la racional, sino la emocional, a la simbiosis de ambas, a lo que se debe apelar. La curva de Gartner, especializada en la frustración, también puede ser vista desde una óptica optimista pues impone límites de horizontes razonables para tecnologías futuras. ¿Qué fue de la clonación reproductiva? En 1996 la oveja Dolly se convertía en el primer mamífero clonado. Superado el primer obstáculo, la transferencia nuclear de células somáticas, intervinieron filósofos y abogados para abordar el segundo problema, la cuestión ética. Un año después, en 1997, la UNESCO lanzaba un documento rechazando la clonación humana que iba en contra de la dignidad humana. En este marco ético, que no legal, se instaba a la comunidad internacional a velar atención por el genoma humano y preservar los derechos humanos. La inmensa mayoría de países se adscribieron a la norma.

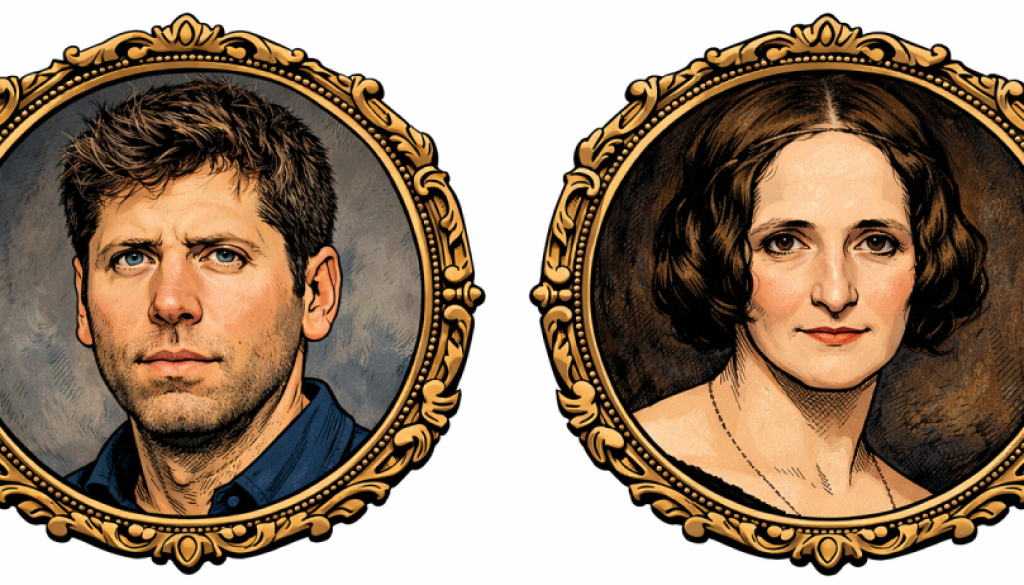

Pero, de nuevo, doscientos años después de la publicación de Frankenstein, apareció un nuevo monstruo… La IA. Fundada en 2015, la empresa OpenAI, iniciaba su singladura con pesos pesados del mundo de la tecnología: Elon Musk, Sam Altam, Ilya Sutskever, Greg Brockman… la mayoría de ellos abandonaría la empresa pocos años después por cuestiones económicas y éticas —de organización sin ánimo de lucro a empresa de ganancias limitadas— y su lema inicial, poner al servicio de la humanidad la inteligencia artificial, pronto se convirtió en una máscara caricaturesca al servicio de la era Trump.

Altman, tal doctor Frankenstein, pronto tuvo miedo de su creación. Algunos medios periodísticos afirmaban que el CEO de OpenAI pronunció estas palabras: «O esclavizamos a la inteligencia artificial o nos esclavizará a nosotros». Fueran literales o una conclusión, resultaba cierto que al directivo y fundador le pesaba cada vez más su criatura. Pero, si se piensa bien, la aplicación del concepto esclavizar, como acción preceptiva contra cualquier entidad, da grima, da igual contra qué o contra quien se aplique, su acepción negativa posee ecos de -ismos, teocentrismo, geocentrismo, androcentrismo, en contra de una visión del mundo integradora y unificadora que busque eliminar centros y construir un mundo holístico: contra esclavizar se puede integrar o hibridar o aceptar. En un paralelismo con la obra de Shelley, la autora ya recogía esta idea entre la relación creador vs criatura y el intercambio de papeles dominante vs esclavo. Criatura:—«Tú eres mi creador, pero yo soy tu dueño: ¡obedece!» vs Doctor:—«Durante todo el tiempo que fui esclavo de mi criatura siempre me dejé guiar por los impulsos del momento…».

En aquellos tiempos, estimada IA, de incertidumbre ante la Curva de Gartner en la que nos habíamos montado, algunas personas se asieron a su tabla surfera de salvación vital versus la IA, el nuevo Frankenstein, el nuevo monstruo, el nuevo Prometeo, que generaba por igual pesadillas aterradoras o sueños de expectativas infinitas.

La técnica Galvánica fue un trasunto de la IA, tecnologías ambas que generaron tantas expectativas como pavor y frustración. Otro nuevo ciclo despierta ante la humanidad y algo se debería haber aprendido de la curva y de la literatura…

La curva de Gartner enseña muchas cosas: la primera, que cualquier tecnología pasada fue peor y que cualquier tecnología futura se creerá mejor; la segunda, que la frustración de una expectativa incumplida acaba incorporándose de manera gradual en la sociedad; la tercera, que el futuro no es predecible.

Al no sobrepasar ninguna tecnología sus expectativas iniciales se genera un marco de incertidumbre propicio para repensar humanísticamente el futuro (me perdonen los Borgs por mi pensamiento antropocentrista) y rediseñar la confianza en un conjunto amplio donde la tecnología tenga cabida, pues ¿no deja de ser la tecnología algo humano? La esperanza en la integración, en la hibridación y en el futuro, en la aceptación del otro, de lo otro, ni es fútil ni tiene porque ser agorera, pero todo este pensamiento solo se alcanzará cuando, para nosotros, la IA se vuelva aburrida.